Ho conosciuto Mister Rubin aka Rubin Mayo grazie alla community di Pyramid Cafè e ci siamo incontrati spesso nei mondi di social VR negli ultimi due anni. Finalmente all’inizio di giugno l’ho incontrato di persona al MUFANT, Museo della Fantascienza e del Fantastico di Torino con cui collabora da anni ed ho scoperto il suo vero nome, Marco Rabino.

Chi è Rubin Mayo

Si definisce su Facebook: scripter, builder, Owner e Landlord su Second Life. In realtà ha studiato al Politecnico di Torino e si occupa di IT.

Come e quando nasce il nickname Rubin?

“Rubin” – pronunciato all’inglese – nasce nel lontano 1994, quando ero militare a Cordenons (Pordenone), ed era il nomignolo con cui mi chiamavano i miei commilitoni (tutti più giovani di me). Quando sono tornato a Torino, nel giugno del 1995 ho deciso di continuare ad usarlo, pronunciato in italiano, anche come nome d’arte per la mia attività di Mago, per cui è nato “Mister Rubin”. Pur avendo praticamente smesso di fare spettacoli di prestigiazione (si è giusto cosi, perché “prestidigitazione” è un settore specifico e ristretto della prestigiazione), continuo ad usare questo nome d’arte anche per firmare i programmi e le pagine web.

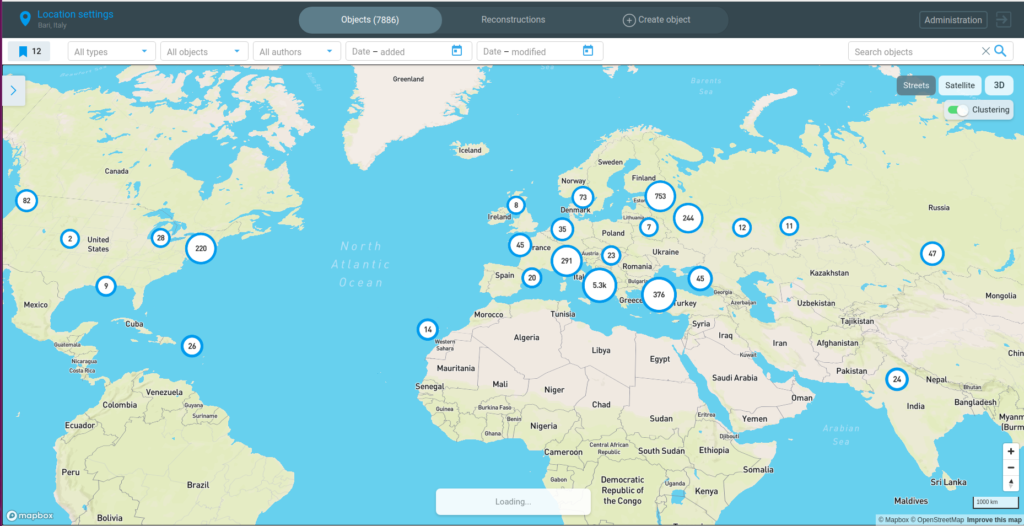

Nel 2007 quando entrai in Second Life, nacque Rubin Mayo, che continuo ad usare in tutte le mie versioni virtuali, in Second Life, Opensim o meglio Craft World, AltspaceVR e VRChat.

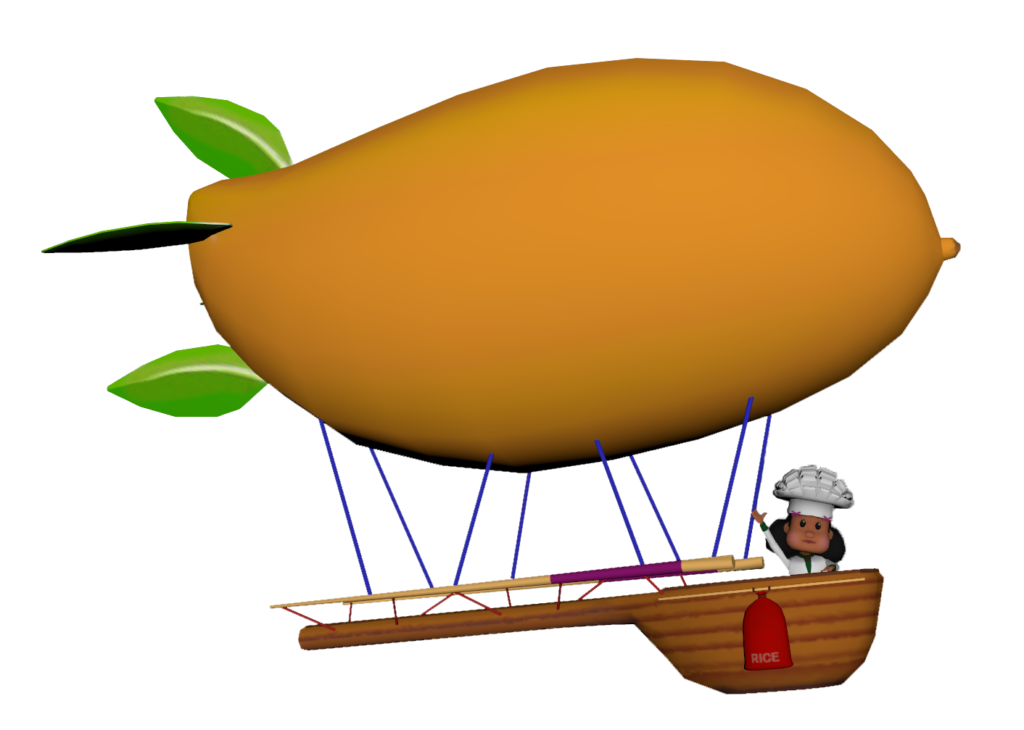

Dovete sapere che Rubin organizza eventi in Second Life, tra i quali anche serate musicali, come ‘Anime in Jazz’, e ‘Italian Cartoons Club’. Dal 18 al 29 maggio scorso ha partecipato alla quattordicesima convention di Fantascienza in SL con 2 installazioni: una dedicata a “Lady Oscar- The Roses of Versailles” e l’altra, “Gundam Park”, dedicata giusto all’Universo – o meglio metaverso – Gundamico.

Quando ti sei avvicinato a Second Life? Che cosa ti ha appassionato?

Entrai in Second Life nel 2007, per la precisione il 19 Luglio: fui incuriosito da un articolo che descriveva ben tre “land” in cui avevano riprodotto parti di Torino, per cui decisi di entrare per visitare queste riproduzioni.

Poi sono rimasto affascinato dalle infinite possibilità espressive di Second Life, il primo “metaverso” realizzato ed operante: non l’ho più abbandonato!

Rubin fa parte del Gruppo Italiano Appassionati GUNdam – GIAGUN e partecipa a vari eventi come Torino Comics, Casale Comics, Model Expo Italy, ecc. come espositore. Nella visita al MUFANT mi ha guidata tra le varie sale con grande passione e competenza. Ma scopriamo quando è nato questo suo ‘amore’. Quando hai iniziato ad appassionarti di questi temi? Quali personaggi preferisci e perché?

Come tecnico in erba, sin da piccolo mi appassionava creare impianti elettrici, e occuparmi di argomenti tecnici e scientifici. La fantascienza mi interessava ma senza essere un fan sfegatato. E neppure i robottoni nagaiani mi interessavano, io preferivo i vecchi cartoni della Warner o della Disney, anche se sul lato anime iniziavo ad apprezzare Capitan Harlock e Lupin III. Nel 1980 sull’allora TMC vidi la scena iniziale di Mobile Suit Gundam, che presentava un futuro in cui l’umanità, spinta dai problemi ambientali del pianeta Terra, ha iniziato ad emigrare in isole spaziali, o meglio colonie spaziali in orbita attorno alla Terra. Da notare che qualche mese prima, un documentario della NASA presentava le stesse colonie viste il quel prologo. Ecco da dove parte la mia scintilla che ancora ora mi porta ad essere un fanatico di tutto quell’universo creativo nato da Mobile Suit Gundam.

Per quanto riguarda la collaborazione col MUFANT, è nata da parecchi anni sempre come rappresentante del GIAGUN: questo Museo è particolare e direi molto singolare, mi piace il suo “DIVENIRE”, il suo cambiare sempre per poter presentare tutti i pezzi ancora non esposti, e per presentare al pubblico sempre nuove iniziative.

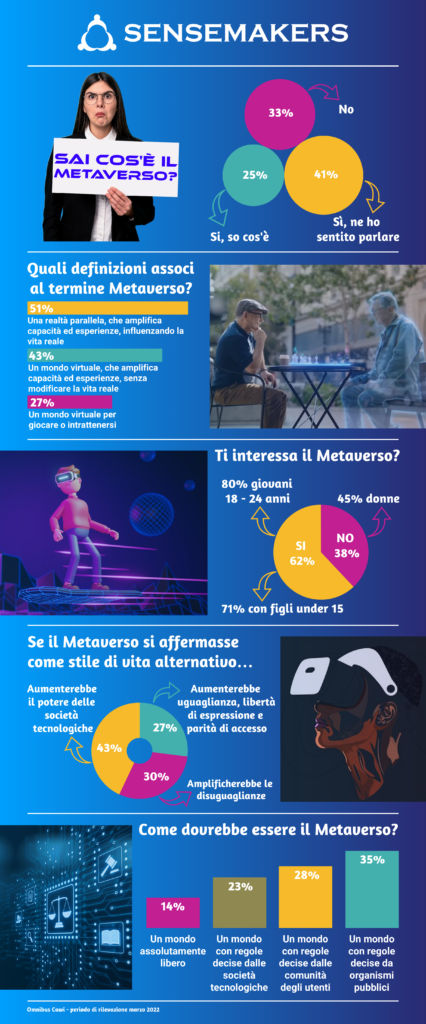

Quali vantaggi e quali rischi vedi nel metaverso in costruzione?

Intanto per me non esiste un solo metaverso, ma ogni insieme di cose reali o irreali che coese costituiscono un “universo oltre” (significato letterale di metaverso) a quello tangibile che sperimentiamo con i nostri sensi è un METAVERSO. La semantica del termine, specie nel mondo anglosassone, continua a confermare quanto detto, visto che gli inglesi continuano a parlare di Star Treek Metaverse, Star Wars Metaverse, Gundam Metaverse, Beautiful Metaverse (si è diventato un metaverso pure quello).

Detto questo, vantaggi e pericoli dei metaversi sono molteplici ed in parte coincidono con quelli già identificati per il web. Per come li vivo io, i metaversi sono estensioni della mia vita, non sono sostituti o sdoppiamenti, o peggio ancora “giochi”.

Partiamo da alcuni vantaggi, secondo me importantissimi: intanto in un metaverso, si impara ad andare oltre l’apparenza, visto che tutti gli avatar sono molto simili, quindi ci si può concentrare sul carattere e sull’interiorità delle persone che si incontrano; si possono incontrare persone che nella vita tangibile potresti non incontrare mai, per cui l’aspetto “community” è e deve essere sempre alla base delle interazioni tra le persone; entrare in nuovo metaverso è un’occasione per estendere la propria conoscenza e la propria cultura, e confrontarsi con persone, conoscenze e culture diverse; è anche l’occasione per re-imparare un po’ di Inglese o addirittura anche altre lingue; in un metaverso in genere è possibile andare oltre i propri limiti e soprattutto le proprie menomazioni fisiche; inoltre alcuni metaversi consentono veramente a tutti, che abbiano o meno la padronanza di strumenti avanzati, di poter creare contenuti e condividerli.

Ora alcuni pericoli.

L’uso di un metaverso fruibile tramite un avatar avviene con possibili molteplici intenzioni da parte delle persone: chi lo vede come una estensione della propria vita, chi lo vede come un grande gioco di ruolo e quindi si costruisce un personaggio diverso da interpretare, chi pensa di poter scappare dalla propria vita nel mondo tangibile e quindi vivere una vita “meravigliosa” o perfetta, chi esprime un latente sdoppiamento di personalità. La cosa è “sana” fino a che si è coscienti di come si sta usando un metaverso, i guai iniziano quando non si tiene conto che ciascuno ha un suo modo di fruizione, quando si perde il controllo, magari anche solo dei propri sentimenti.

Intanto è sempre possibile incontrare persone malintenzionate o meschine che possono approfittarsi della situazione o dei sentimenti altrui. Anche andare oltre sentimenti di amicizia è pericoloso, c’è chi si innamora di un’altra persona, per poi scoprire dolorosamente, molto dolorosamente, che l’altra persona stava solamente giocando di ruolo o peggio; quindi ci sono i pericoli, amplificati, di una relazione sentimentale reale.

Senza contare le patologie: qualcuno potrebbe rimanere “prigioniero” di questa vita ideale vissuta in un metaverso, oppure sviluppare tutta una serie di comportamenti psichici devianti, o anche solo isolarsi ulteriormente dal mondo tangibile e dalle altre persone presenti in esso.

Quali consigli potremmo dare ai genitori che non conoscono o frequentano poco questi mondi (gaming e social VR)?

Domanda difficile. Intanto bisogna educare meglio i ragazzi, oggi i genitori sono troppo permissivi e non preparano i giovani ai NO che la vita ti sbatte in faccia. Il risultato è che creano nei ragazzi la convinzione di poterle avere “tutte vinte”. Questo non fa bene né ai ragazzi e neppure ai genitori. Occorre educare alla pratica del rispetto per se stessi e per gli altri: senza questa pratica il giovane rimane facilmente vittima di ogni manipolazione, e vale sia per la vita nel mondo tangibile sia per i social network, sia nei metaversi. Occorre far capire ai ragazzi che non è importante avere centinaia di follower in un social network, ma avere degli amici veri, anche se pochi.

Occorre insegnare ai ragazzi che è importante ESSERE, non l’AVERE o l’APPARIRE. Questo è un compito importante trascurato da troppi genitori moderni nell’educazione dei giovani. Occorre anche educare i giovani alla vita in comune anche con estranei o quasi, a rinunciare un po’ del proprio egoismo in favore di un bene comunitario maggiore.

Ma tutto questo vale a prescindere!!!

Nello specifico i genitori per primi dovrebbero formarsi sui pericoli della rete, e dovrebbero per osmosi passare questa formazione anche ai giovani, che imparano subito le funzionalità dei nuovi media, ma ne ignorano completamente i pericoli e gli inganni.

Infine i giovani dovrebbero imparare a dare il giusto peso ad ogni cosa che accade nella loro vita e anche in questo i genitori devono essere d’esempio e guida.

Quali esperienze hai provato e suggerisci nei mondi di social VR?

VR e non solo, parliamo di metaversi in generale, la VR è solo una modalità di fruizione. Di sicuro consiglierei di entrare e vivere nei vecchi mondi virtuali come Second Life e open sim, e a sperimentare tutte le possibilità espressive e comunicative di questi vecchi mondi: posso assicurare che tutto quello che sta venendo in mente ai nuovi guru dei metaversi, in SL lo abbiamo già sperimentato e approfondito. Inoltre proprio in SL, si possono trovare appassionati di ogni sorta e su ogni argomento, basta avere la volontà di cercare nelle land e nei gruppi.

E comunque consiglio di entrare in un metaverso senza avere troppe aspettative o preconcetti o pregiudizi, esplorarlo, sperimentarlo, trovare altre persone con cui condividere l’esperienza: solo approfondendone la conoscenza è possibile capire un metaverso, come funziona e cosa offre.

Che cosa pensi degli NFT? Saranno solo una bolla oppure potranno rappresentare un futuro per l’arte?

L’argomento è molto complesso.

Oggi parlare di NFT vuol dire principalmente parlare di una bolla speculativa, di un qualcosa discriminatorio e divisivo tra chi sostiene la gratuità della fruizione delle opere d’arte e chi invece si bea dei propri soldi e li vuole mettere in mostra.

Una cosa ho capito dell’arte: se non è fruibile è come se non esistesse. Nella storia i mecenati hanno sempre finanziato gli artisti affinché potessero realizzare le proprie opere e metterle a servizio della comunità: ed è quello che ancora accade in molti metaversi.

Se poi vogliamo permettere agli artisti di gestire da soli la possibilità di guadagnare, gli NFT possono essere uno dei mezzi per farlo, a patto che nei vari metaversi uno possa poi rendere disponibile la fruizione dell’opera d’arte associata ad un NFT, altrimenti rimane un’opera morta che non può essere goduta o condivisa.

Occorre trovare il giusto equilibrio, ma in generale posso affermare che l’arte nei metaversi non necessariamente ha bisogno degli NFT.